Son tiempos convulsos. La IA empieza a notarse en multitud de ámbitos. Algunos de estos ámbitos son más públicos que otros, abarcando formatos diferentes. Me ha parecido que podría ser interesante hacer un repaso de los formatos y contextos en los que empieza a aplicarse la IA con el objeto de sustituir literalmente a un humano, es decir, allí donde la IA busca confundirse en mayor o menor medida con un humano, de forma transparente o no. No me refiero a los casos en los que se usa como capa visible de un humano (como su avatar), aunque también mencionaré algunos casos, sino cuando no hay nadie más al volante que una IA de generación de texto.

De eso va a tratar la newsletter de hoy. Haré un pequeño viaje por los niveles de complejidad, diferenciando siempre entre entornos no interactivos e interactivos (estos últimos son los más complicados obviamente ya que implican una simulación en tiempo real). Allá vamos.

Filtros

Antes de nada me gustaría empezar por algo que considero como el ancestro de las IA como simulación de humanos. Me refiero a los filtros de belleza de las redes sociales, ya sean para Instagram, Snapchat o TikTok. Aunque, de justicia, deberíamos hablar solo de las 2 primeras, que son las pioneras en ese campo. Los filtros que había al principio solo afectaban a la cara pero hoy en día podemos ver filtros más avanzados que modifican no solo la cara sino también el resto del cuerpo.

Es sabido que esto creó un nuevo problema para la sociedad, generando nuevas patologías como la dismorfia del selfie (que afecta sobre todo a los adolescentes).

No es un ejemplo de una IA como humano, pero sí de como los humanos empezaron a querer ser otras personas mediante la IA empujados por las redes sociales.

Ahora sí. A partir de ahora veremos aplicaciones de IA’s que pretenden (de forma transparente o no) hacernos pensar que lo que leemos, vemos y oímos es una persona real.

Deepfakes

Una evolución clara de los filtros son los deepfakes. Los deepfakes no son más que filtros superavanzados. Así que en esta categoría podríamos incluir tanto a los filtros avanzados usados en interacciones en tiempo real como los deepfakes elaborados con herramientas avanzadas. Si bien inicialmente era algo costoso de hacer, en el que debíamos realizar muchos análisis previos y dar muchos datos sobre la cara de la persona a reemplazar, hoy en día se pueden obtener buenos resultados con la mínima información (apenas una sola imagen).

Algunos de los ejemplos que hemos podido ver relacionados con esto son de un uso poco ético o directamente ilegales.

Los usos más reprovables son los relacionados con el porno de celebrities mediante deepfakes y las estafas mediante deepfakes de famosos como Elon Musk o diversos presentadores de televisión. Se han generalizado los deepfakes en la prensa, en las conocidas como fake news. Todos ellos ejemplos de deepfakes no interactivos.

También se están utilizando deepfakes en modo interactivo para realizar estafas. No hace mucho alguien fue capaz de manejar una reunión virtual manejando de forma simultánea a varios deepfakes al mismo tiempo. Poca broma, consiguió estafar 24 millones de dólares.

En el ámbito de los deepfakes interactivos, en China empresas como Xiaoice o Silicon Intelligence realizan clones de influencers streamers que son capaces de vender 24 horas durante los 7 días a la semana en plataformas de stream como Taobao, Douyin o Kuaishou. El clon no solo mueve los labios de forma sincronizada con el texto (realizado por un humano o generado por IA) sino que mueve también las manos de forma coherente con lo que dice. Incluso es capaz de “leer“ el chat en busca de temas disponibles en base de datos con el objetivo de dar respuestas emuladas.

Por no hablar de las cuentas clones de famosos, de las que ya he hablado por aquí.

Chatbots

Los chatbots estan entre nosotros desde hace mucho pero no eran algo relevante a nivel “test de Turing“ hasta la aparición de ChatGPT y los LLM basados en chat que han aparecido tras él (Claude, Gemini, Llama, Gemma…).

El formato de texto permite centrarse en lo más importante, la conversación. Eso hace que este tipo de formato funcione tan bien a la hora de hacer pasar a una IA por un humano.

Meta ha usado este formato para montar modelos que contesten chats temáticos como lo harían famosos (Snoop Dogg, Paris Hilton, Kendall Jenner, Charli D'Amelio…).

La influencer Caryn Marjorie (1,8 millones de seguidores en Snapchat) ha creado su propio modelo Caryn.ai y al parecer ha ingresado $72.000 la primera semana (facturando $1 el minuto de conversación).

También tenemos plataformas específicas, como la popular Character.ia, que permite conversar con versiones emuladas de todo tipo de personajes famosos, desde personajes históricos hasta de ficción. Incluso permite crear tus propios modelos.

Otra popular aplicación, Replika, permite tener un compañero IA. Claramente orientado a la búsqueda de compañero sentimental IA. Algunos como este usuario de Reddit, quieren hasta formar una familia. La cineasta china Chouwa Liang ha rodado un documental con el testimonio de 3 mujeres con compañeros sentimentales en esa misma plataforma: My A.I. lover.

Nota: Replika incluye un avatar, pero es tan poco realista que me apetece incluirlo en la sección de chatbots.

Laurie Anderson, pareja del difunto Lou Reed, ha declarado últimamente estar tristemente enganchada (literalmente “sadly addicted“) a las conversaciones con una IA entrenada con textos de Lou Reed. Esto me ha recordado a aquel episodio de Black Mirror llamado Be Right Back. La emulación a través de chatbot ha conseguido llegar a un nivel tan bueno que es capaz de convencer a propios y extraños.

Voces

Las voces sintéticas hace mucho que existen, pero su calidad ha ido aumentando con el paso del tiempo. Si combinamos voz sintética con la generación de texto de los chatbots tenemos a una IA que es capaz de hablarnos. No entraré a evaluar esa parte, que obviamente centra su mérito en la generación del texto, me centraré en la parte relativa a la generación de modelos de voz. Lo novedoso hoy es la capacidad de realizar modelos de voz clonando cualquier voz a partir de unas pocas locuciones de prueba.

Actores como James Earl Jones han cedido ya sus derechos para que se pueda usar su voz en películas (podremos seguir oyendo a Dark Vader). Algo que está tan al alcance de todo el mundo que cualquiera puede clonar cualquier voz popular de forma sencilla (tal y como le pasó a Stephen Fry). Incluso una de las herramientas más populares para el clonado de voz, Elevenlabs, ha decidido montar una plataforma para que los profesionales de la locución pongan su voz a la venta (y así poder monetizar su modelo de voz).

La lista de herramientas que realizan el clonado de voz es cada día más grande para bien o para mal: Elevenlabs, PlayHT, Speechify, Murf AI…

Nota: Aquí tengo que decir que he probado varios y algunos tienen cierta tendencia en la traducción (cuando se clona y traduce a la vez) a conservar cierto acento al idioma original. Cosa que tiene cierta lógica.

Gracias a esta tecnología podemos disfrutar de podcasts traducidos mediante voz clonada como éste con la versión en español del podcast sobre IA de Lex Fridman:

Réplicas virtuales

Toca hablar de las replicas virtuales. Al igual que en el anterior caso, el mérito de la inteligencia de la IA está en el texto. Aquí me centraré en hablar de los esqueletos virtuales que dan vida a ese texto.

Hace mucho tiempo que aparecieron las películas en las que aparece el uso de CGI (computer generated images), es algo que ya hemos visto. Lo novedoso es que esté al alcance de casi cualquiera.

Como en el caso de la voz, también hay actores, como Bruce Willis, que han licenciado su imagen para que se puedan hacer películas con ella.

Si no queremos usar un clon de nadie también podemos crear nuestro humano digital para usar con la IA de turno. Un buen ejemplo de esto es la empresa Epic Games y su Metahuman para el motor Unreal.

Por otro lado la llegada de la IA ha hecho innecesario el paso por los clásicos motores gráficos. Así, como en el caso de la voz, también en la imagen de vídeo disponemos de una serie de herramientas que nos permiten realizar vídeos con avatares parlantes o traducciones (con clonado de voz o no) de vídeos con lipsync incluido (movimiento de labios sincronizado): Synthesia, Heygen, Vidnoz, Deepbrain…

A nivel de réplicas digitales interactivas podemos ver algún ejemplo más o menos realista como la Virtual AI Girlfriend de Myanima.

Quizás los NPC de los videojuegos acaben siendo réplicas digitales con las que podamos hablar de cualquier cosa, sin textos preprogramados. Hasta ahora tenemos que conformarnos con tecnologías de avatares usadas en el contexto de metaversos y a los que se ha conectado a la IA. Por ejemplo, podemos hablar con Benjamin Franklin a través de la tecnología de Engage.

Este formato será el que más tenga que evolucionar, sobre todo en el ámbito de la interacción en tiempo real. Quizás el metaverso sea el último empujón para esta tecnología.

AInfluencers

Quería dedicar un apartado exclusivamente a un caso concreto de las réplicas digitales. Los nuevos influencers artificiales, también llamados AInfluencers en un alarde de originalidad.

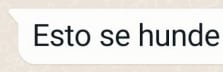

Si alguna vez pensaste que nadie haría caso a un personaje generado por ordenador piénsalo de nuevo después de mirar estos datos.

En realidad, los influencers al uso tienen poca credibilidad, o digamos que no influyen tanto como otros factores a la hora de la compra de productos. Quiero decir que el listón está bajo (ojo, menos credibilidad que resultados generados por IA). La escalabilidad productiva que proporciona tener un influencer artificial merece la pena intentar crear desde cero influencers para evitarse pagar una “nómina” abultada. Ya empieza a ser común ver agencias especializadas que explotan sus propios modelos de modelos (se entiende no? modelos de modelos… jeje).

La agencia TheClueless ha creado dos de las que más se ha oído hablar últimamente: Aitana López (cobra 1000 euros por anuncio, precio acorde a su audiencia de más de 300.000 seguidores en instagram a día de hoy) y Maia Lima.

La agencia Aww de Tokio especializada en modelos virtuales AI también tiene sus creaciones. Imma Gram (casi 400.000 seguidores en instagram), Plusticboy o Ria Ria son algunos modelos virtuales de su catálogo. Alguno de ellos, como Kaili, usado para streaming como vtuber. En este último caso, una máscara que esconde a un humano, por lo menos de momento.

La agencia Happy Fish ha colaborado con la marca de ropa Marks & Spencer para crear a Mira, una modelo virtual exclusiva para su marca.

La agencia VIA Talents Agency ha creado también a la presentadora Alba Renai, que hasta tiene su propio perfil en Linkedin, para presentar la sección de contenido digital asociado al programa de televisión Supervivientes.

No es algo nuevo, en China ya se hacía esto en 2018, sino una prueba más de que es más asequible hoy que hace 5 años.

Cuando la tecnología usada tiene que ver con la creación de modelos para motores gráficos la consistencia del modelo está asegurada, pero no funciona tan bien como cuando se usan modelos de generación de imagen, donde la consistencia es más difícil. Pero esto es algo que estoy seguro cambiará a corto plazo (tenemos todos a Sora en la cabeza).

Ya podemos ver algunas herramientas especializadas para la creación de AInfluencers, como RenderNet. Incluso hay cursos para que el que quiera se lo monte por su cuenta.

Hologramas

Categoría especial a los hologramas. No son nada nuevo, ya que en Japón lleva más de una década triunfando Hatsume Miku, un avatar que canta canciones realizadas con el programa Vocaloid.

Más reciente es la explotación nostálgica de este formato. Avatares del grupo ABBA están haciendo conciertos en Londres en un espectáculo llamado ABBA Voyage.

KISS se ha retirado y está preparando una continuación en forma de avatares holográficos.

Elvis Presley también reaparece en una serie de conciertos en formato de IA holográfica: Elvis Evolution. Inician en Londres y se pasarán por Las Vegas, Tokio y Berlin.

Robots

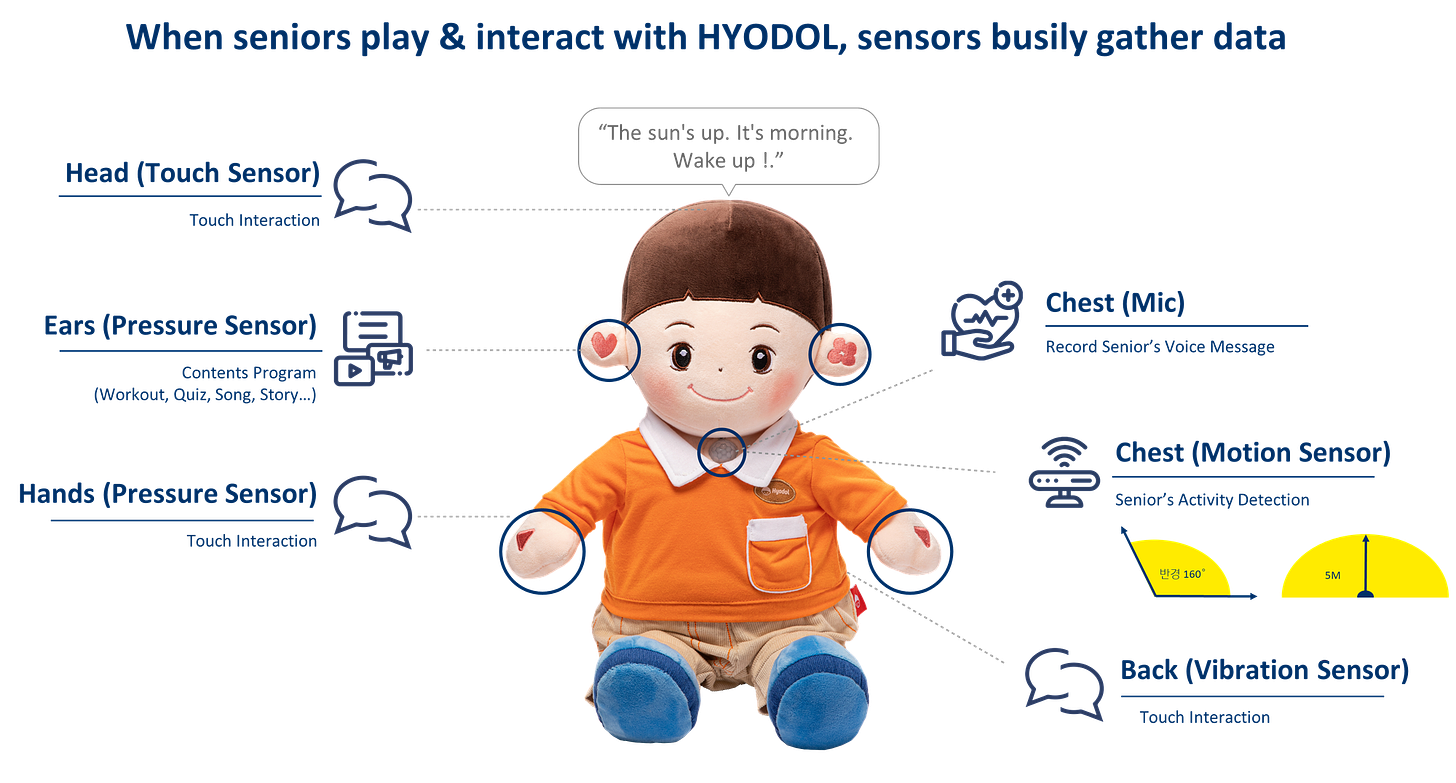

La última frontera es dotar a la IA de un cuerpo. Empiezan a haber aplicaciones muy de nicho como los muñecos para ancianos.

O las clásicas muñecas sexuales a las que ya les están poniendo ChatGPT.

Más allá de estas aplicaciones, lo que en realidad se busca es al robot que pueda hacer de todo, como un humano. Hemos visto recientemente como OpenAI ha establecido un acuerdo con Figure AI para incorporar IA a sus robots.

Por otro lado Nvidia acaba de anunciar una nueva plataforma, GRooT, para el entrenamiento de robots humanoides de propósito general. La plataforma será usada por empresas fabricantes de robots como 1X Technologies, Agility Robotics, Apptronik, Fourier Intelligence, Sanctuary AI, Unitree Robotics, XPENG Robotics, Boston Dynamics e incluso por la propia Figure AI.

El resumen general del envío de hoy es que la tecnología es mejor, más asequible económicamente y más fácil de usar cada día que pasa. Eso es un factor exponencial que va a hacer cada día más normal que recibamos contenidos e interaccionemos con replicantes (como los de Blade Runner).

Pensemos que, en un mundo en el que la IA se haya convertido en una commodity, lo escaso será lo humano.

Despedida y cierre

El tono de hoy puede que me haya quedado un poco pesimista. No ha sido mi intención. Solo tengo un poco de miedo al posible spam versión AI. Por lo demás, seguro que no nos vamos a aburrir.

Esta semana creo que me ha quedado un envío algo denso. La semana que viene algo más breve si puedo.