Quanta energia serve per una query su ChatGPT?

Anche se, forse, sarebbe meglio chiedere: quanta ne servirà. Appena due mesi dopo il suo lancio a novembre del 2022, ChatGPT contava già 100 milioni di utenti attivi e, da allora, sembra essere scattata la corsa impetuosa per applicare l’AI generativa a tutti i campi possibili: dalla scrittura di testi ai trapianti di organi passando (ça va sans dire) dalla modellistica climatica – al punto che in molti ci stiamo chiedendo:

💭 Come faremo ad assicurarci che i pro non siano superati dai contro?

Tutta questa AI, infatti, richiede potenza di calcolo e dunque elettricità.

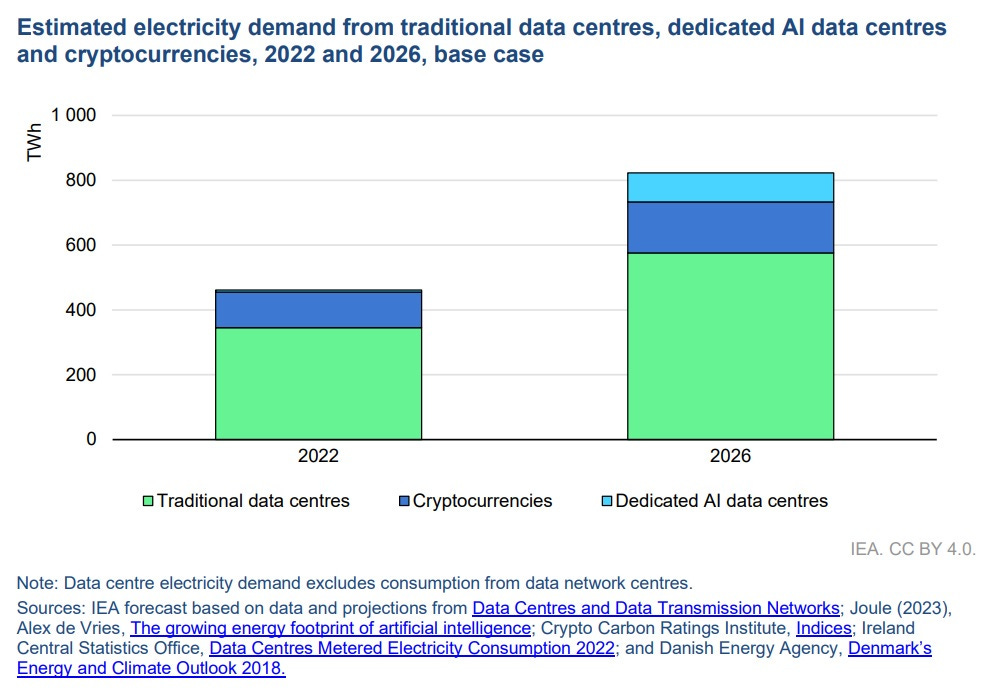

Come raccontato qualche giorno fa, infatti, la IEA si aspetta che nel 2026 il consumo di elettricità dei datacenter AI arrivi a toccare i 90 terawattora (TWh). Si tratta di un numero enorme, pur tenendo conto del fatto che “incorpora” i consumi dei sistemi di raffreddamento, degli ausiliari etc.

La preoccupazione aumenta, al punto che in Europa il programma AI Act, approvato dagli Stati Membri a inizio febbraio, richiederà che gli “high-risk AI systems” (tra i quali rientrano i potenti modelli che alimentano ChatGPT) rendicontino i consumi di energia durante tutto il loro ciclo di vita.

In attesa dei numeri precisi, può essere divertente iniziare a farci un’idea.

Un primo tentativo

“Domandare è lecito, rispondere è cortesia.”

Proverbio

Inutile dire che la prima cosa che ho provato a fare è stato chiederglielo. A ChatGPT, dico. Tuttavia, non sono riuscito a cavare un ragno dal buco: come in molti argomenti che richiedono una buona capacità di astrazione, ChatGPT ha frugato nell’immenso database di campioni di testi da cui pesca, per restituirmi questo:

Il tono è quello che ci siamo abituati a riconoscere: una serie meccanica di perifrasi vaghe, infarcite di lessico ripetitivo.

Forse, una stima umana è più illuminante.

Un secondo tentativo

“Quando puoi misurare ciò di cui stai parlando, ed esprimerlo in numeri, puoi affermare di saperne qualcosa; se però non puoi misurarlo, se non puoi esprimerlo con i numeri, la tua conoscenza sarà povera cosa e insoddisfacente.”

- Lord Kelvin

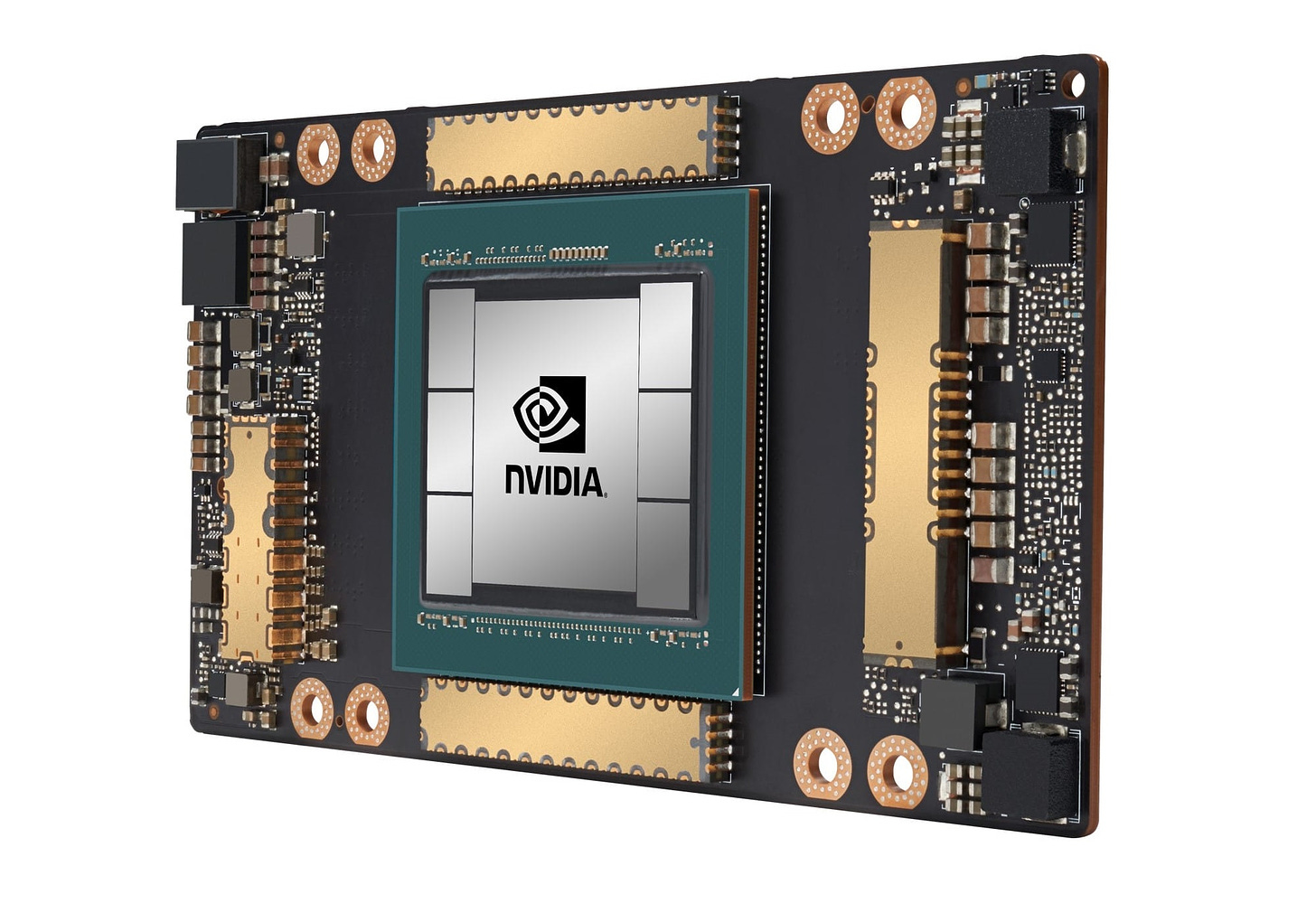

I modelli come ChatGPT vengono allenati ed eseguiti su Graphical Processing Units, o GPU. Si chiamano così perché rappresentano il cuore delle schede video: hanno una forma d’architettura massivamente parallela, cioè eseguono lo stesso calcolo su dati diversi con più unità di calcolo simultaneamente. Questo le rende ideali per eseguire in modo rapido compiti dispendiosi: l’elaborazione di dati grafici (nelle schede video) ma anche i servizi di AI generativa o mining di criptovalute.

Secondo questo articolo, per allenare il modello GPT-3 ci sono voluti 405 anni V100: vuol dire che, se fosse stata usata una sola GPU Nvidia V100 (da 300 W), ci sarebbero voluti ben 405 anni. Vuol dire che un ipotetico viaggiatore nel tempo avrebbe potuto iniziare a usare la GPU all’inizio della guerra dei trent’anni, perché il modello fosse pronto per il rilascio della sua prima versione, a novembre del 2022.

Siccome la GPU assorbe una potenza di 300 W, questo vuol dire che per allenare GPT-3 sono serviti 300 W x 24 ore x 365 giorni x 405 anni = 1’064’340’000 Wh di energia, ca. 1’064 MWh. Per mettere questo numero in prospettiva: un’ora di streaming su Netflix richiede circa 0.8 kWh (= 0.0008 MWh) di energia elettrica: quindi per consumarne un quantitativo pari a quello usato per allenare GPT-3 dovresti stare davanti alla TV per 1’330’000 ore. Abbastanza per guardare tutti i 279 episodi di The Big Bang Theory per 14’300 volte di fila.

Quando si dice binge watching 👀

A questa, però, va aggiunta l’energia che serve per eseguire il modello (inference). Dato che OpenAI usa ca. 3’617 server HGX A100 (ciascuno dei quali consuma 3 kW), allora il consumo in un giorno è 3’617 x 3’000 W x 24 ore = 260.42 MWh.

Se consideriamo che in un giorno il sistema gestisce 195 milioni di queries, ecco che il “costo” energetico di ciascuna è di (1’064 MWh + 260.42 MWh)/195 milioni = 6.79 Wh. Vuol dire che un paio di query su GPT-3 usano la stessa energia che serve per caricare il tuo smartphone (0.012 kWh in media).

Possiamo fare meglio?

Questo lo stato ad oggi.

Ma quanto è efficiente? In altre parole, quanto è ampio il margine di miglioramento?

Il quesito è urgente, perché già le criptovalute avevano esercitato una pressione non indifferente sulle reti elettriche: rivitalizzando vecchi impianti a combustibili fossili, il cui “pensionamento” ha rischiato di slittare, e spingendo alcuni Stati come quello di New York a intimare lo stop sul proprio territorio a nuove facility dedicate al mining di criptovalute.

L’AI potrebbe dare alle reti il colpo di grazia?

Di sicuro sta aumentando la pressione, con effetti evidenti su aree apparentemente scollegate dal calcolo, come lo sviluppo urbanistico: per es., a Londra la costruzione di nuove abitazioni ha iniziato a rallentare, proprio per dei vincoli sulla quantità di elettricità disponibile.

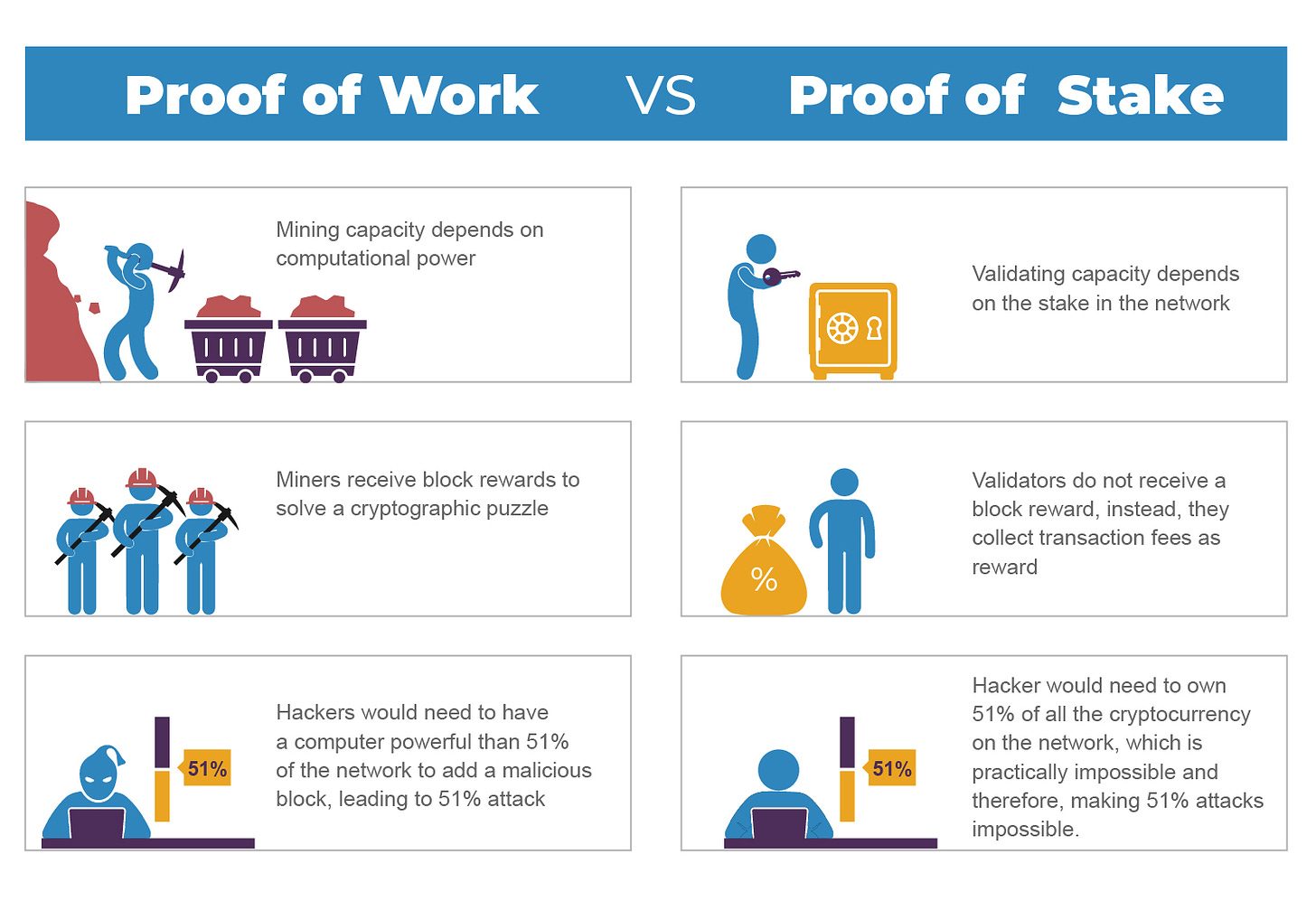

Per le criptovalute, qualche (considerevole) successo c’è stato: penso principalmente alla blockchain di Ethereum, che ospita la seconda criptovaluta più grande al mondo, e al famoso “Merge” del 2022. Alle 2:43 am EST del 15 settembre, senza grossi intoppi, Ethereum ha cambiato il metodo usato per validare le transazioni, dal Proof of Work (PoW) al Proof of Stake (PoS).

In tal modo, Ethereum è riuscita a ridurre i propri consumi di elettricità del 99.98%. Niente male visto che la blockchain, prima del Merge, assorbiva tanta elettricità quanta ne consuma in un anno il Bangladesh. Per avere un’immagine mentale chiara di cosa sia un taglio del 99.8%: è come ridurre la torre Eiffel alle dimensioni di una minifigure di un set LEGO.

Le emissioni di CO2 associate al token Ether hanno seguito a ruota, passando dagli 11 milioni di tonnellate pre-Merge a “sole” 870 tonnellate.

Dunque, è sensato chiedersi: è possibile fare lo stesso con l’AI?

Il lato diabolico dell’informazione

“[…] se la tua teoria è contraria alla Seconda Legge della Termodinamica, non posso darti alcuna speranza; non resta che crollare nella più profonda umiliazione.”

- Sir Arthur Eddington

La risposta, come spesso accade in ingegneria, è: fino a un certo punto.

Per capire come mai, a me torna utilissimo un esperimento mentale proposto nel 1871 da James Clerk Maxwell per ragionare sulla Seconda Legge della Termodinamica: una creatura immaginaria “in grado di giocare di destrezza” su scala molecolare. O, come lo chiamò più tardi Lord Kelvin, un diavoletto.

L’idea è di avere un gas contenuto in un recipiente, diviso in due camere adiacenti inizialmente alla stessa temperatura. Le due camere sono separate ermeticamente da una parete, nella quale però è ricavata una porticina. Lì sta il diavoletto di Maxwell, un essere intelligente in grado di monitorare le singole molecole. Poiché è dispettoso e infrange le regole, decide che violerà la Seconda Legge della Termodinamica. Inizia ad aprire e chiudere “selettivamente” la porticina, in modo da raccogliere le molecole più veloci (calde) in una delle camere e quelle più lente (fredde) nell'altra.

L’obiettivo del diavoletto è di diminuire l'entropia del gas, senza compiere egli stesso un lavoro. Infatti, una volta creata una differenza di temperatura tra le due camere del recipiente, essa potrebbe essere sfruttata per alimentare un motore termico e produrre lavoro utile. Energia gratis: praticamente un Superbonus ante litteram.

Tuttavia, il suo piano fallisce miseramente. Dove sta l’inghippo?

Il punto è che, per monitorare le molecole e decidere quando aprire la saracinesca, il diavoletto deve registrare coordinate e velocità di ciascuna molecola. E nel fare ciò, il diavoletto “suda”: la sua memoria, infatti, non è infinita. Per un ciclo termodinamico completo, è necessario che il diavoletto resetti periodicamente la propria memoria al suo stato iniziale, cancellando bit di informazione.

In altre parole: qualsiasi manipolazione logicamente irreversibile di bit ha un “costo energetico” inevitabile. Si tratta, cioè, di un processo dissipativo accompagnato da un certo quantitativo di calore che non può scendere sotto una certa soglia, il cosiddetto limite di Landauer.

Tutto OK, la Seconda Legge della Termodinamica è salva.

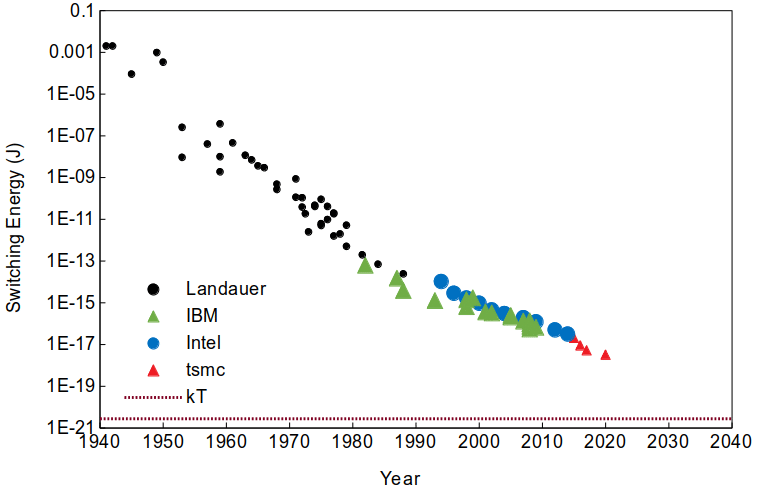

Dopo aver cancellato i voli per Stoccolma: a proposito di AI, vale la pena notare come il limite di Landauer sia un numero molto piccolo. Se indichiamo con k la costante di Boltzmann e con T la temperatura assoluta, il limite di Landauer è pari a k T ln(2) - la linea rossa nel grafico qui sotto.

Se guardiamo solo la linea rossa, potremmo essere tentati da un ottimismo eccessivo. A temperatura ambiente (25 °C = 298 K), una CPU che funzionasse vicino al limite di Landauer potrebbe commutare un miliardo di bit al secondo consumando solo 2.85 milionesimi di milionesimo di watt.

Tuttavia, il punto è che verso quella linea rossa ci stiamo avvicinando a grandi falcate. Nell’arco di appena 80 anni, l’efficienza energetica dei processori è migliorata di 15 ordini di grandezza. I transistor sui chip prodotti nel 2020 consumano circa 3×10−18 joule, circa 1’175 volte il limite di Landauer.

Ci restano, in altre parole, solo altri tre ordini di grandezza.

L’espansione tumultuosa che stiamo vivendo è il frutto di un hardware overhang: al fine di prolungarlo quanto più possibile e fare fronte alla crescente domanda di servizi AI (senza compromettere la riduzione delle emissioni) sarà cruciale riuscire a mantenere basso il costo dell’energia elettrica, mentre la si decarbonizza.

Nel momento in cui ciò non dovesse succedere, il prezzo della potenza di calcolo non calerà altrettanto velocemente in futuro. Ciò vorrà dire che la soluzione non potrà più essere un “becero” aumento nella quantità di GPU; toccherà, invece, lavorare di lima sugli algoritmi, compito molto più arduo in cui il progresso è molto più lento.

Dopo i primi due (1974–1980 e 1987–2000), nell’arco di 20 anni potrebbe attenderci un terzo inverno dell’AI: quello di Landauer.

🧰 Toolbox

De Vries A., The growing environmental impact of Artificial Intelligence, 2023

International Energy Agency, Electricity Report, 2024

🔊 Resonance frequency

“AI will reward us when it reigns” auspica Grimes, mentre presta giuramento di fedeltà al più potente computer mai esistito. Non resta che sperare di aver abbastanza elettricità clean firm per alimentarlo. Nucleare incluso.

💌 Condividi la tua esperienza

🙏 Grazie, come di consueto, per il tuo interesse. Se trovi valore in questo numero e in questa newsletter, spargi la voce: puoi condividere The Nuts and Bolts con amici, dire la tua lasciando un commento o partecipando al sondaggio qui sotto.